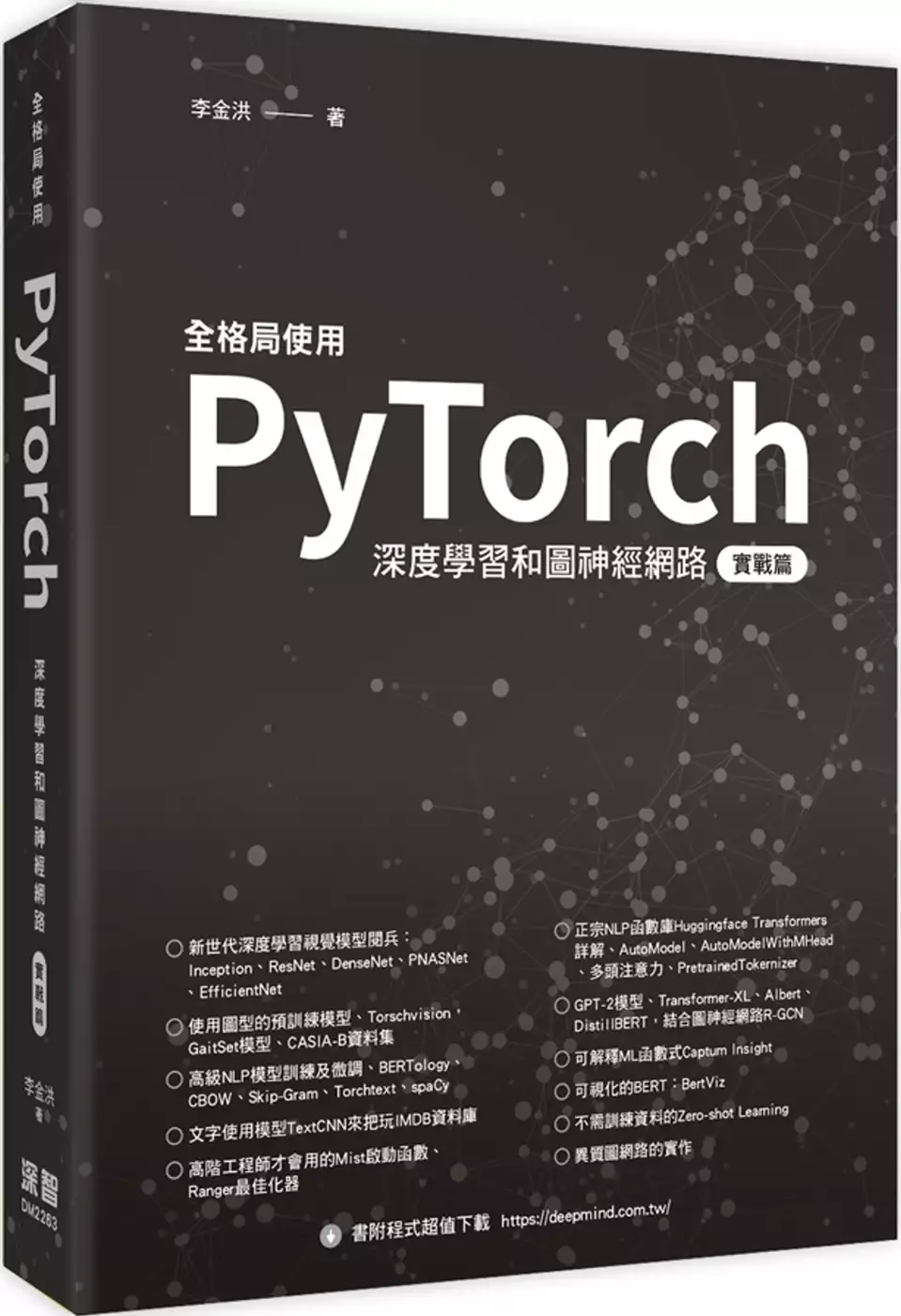

ocr工具的問題,我們搜遍了碩博士論文和台灣出版的書籍,推薦李金洪寫的 全格局使用PyTorch:深度學習和圖神經網路 實戰篇 和李金洪的 全格局使用PyTorch - 深度學習和圖神經網路 - 基礎篇都 可以從中找到所需的評價。

另外網站在线ocr工具 - 稀土掘金也說明:在线OCR 工具是指可以在网络上使用的OCR(Optical Character Recognition,光学字符识别)软件。使用这种工具,你可以将扫描的文档或者数码照片中的文字转化为可编辑的 ...

這兩本書分別來自深智數位 和深智數位所出版 。

國立臺灣師範大學 華語文教學系 蔡雅薰所指導 歸皮爾的 料理漫畫運用於華語教學之研究 (2019),提出ocr工具關鍵因素是什麼,來自於華語教學、內容和語言的整合學習、廣泛閱讀教學、漫畫、二語習得。

而第二篇論文國立中央大學 資訊工程學系 鄭永斌所指導 簡嘉慶的 Very High Precision Optical Character Recognition For Clean-Fixed-Sized True Type Characters (2016),提出因為有 光學文字辨識、動態規劃的重點而找出了 ocr工具的解答。

最後網站光學字元辨識(OCR)科技的過去與未來則補充:這就是OCR和ICR等掃描科技發揮作用的時候。您可以使用OCR工具掃描打印的文件並數碼化所有文字。 OCR的科技已經廣泛使用,您可能已經很熟悉,它 ...

全格局使用PyTorch:深度學習和圖神經網路 實戰篇

為了解決ocr工具 的問題,作者李金洪 這樣論述:

熟悉基礎,精通實戰。 接續了上一本實戰篇的基礎,本書將介紹目前最流行的物體辨識和自然語言處理在圖神經網路上的最完整應用。當你熟悉了神經網路之後,接下來要精進的就是針對網路結果的強化及最佳化。在GNN的基礎上,針對目前最流行的視覺處理模型進行修改、架設及強化,並且實際應用在現有的平台上。本書的重點就是大量了使用現有的Python函數庫,並且應用了最新的資料集,讓你能真正看到資料套用在模型上的強大能力。在針對Pytorch的函數庫上,不但有視覺應用,更有號稱人工智慧明珠的NLP應用。使用了Torchtext以及NLP的唯一/最佳選擇Huggingface Transformers。而大家

耳熟能詳,但又不知道怎麼用的模型,包括GPT-2、Transformer-XL、ALBERT、ELECTRA、DistillBERT等,在書中都有詳細介紹。另外為了解開DL的神祕,本書也難得介紹了Captum套件,讓深度神經網路更具可解釋性。本書最後也不忘介紹ZSL、這種極少量資料就可訓練高精度模型的方法。有關異質圖神經網路部分,也有大量DGL和NetworkX的範例,實戰篇+基礎篇兩本書,要不充分了解GNN都不行。 本書特色 ~GNN 最強實戰參考書~ ●使用圖型的預訓練模型、Torschvision,GaitSet模型、CASIA-B資料集 ●高級NLP模型訓練及微調、BE

RTology、CBOW、Skip-Gram、Torchtext、spaCy ●文字使用模型TextCNN來把玩IMDB資料庫 ●高階工程師才會用的Mist啟動函數、Ranger最佳化器 ●正宗NLP函數庫Huggingface Transformers詳解、AutoModel、AutoModelWithMHead、多頭注意力、PretrainedTokernizer

ocr工具進入發燒排行的影片

有問題不要問= =

YoloMouse 滑鼠特顯

https://store.steampowered.com/app/1283970/YoloMouse/

ExilenceNext 倉庫統計

https://github.com/viktorgullmark/exilence-next

AwakenedPoeTrade 查價

https://github.com/SnosMe/awakened-poe-trade

PoeTradesCompanion 交易視窗化工具

https://github.com/lemasato/POE-Trades-Companion

PoEHarvesterVendor 菜園工藝

https://github.com/esge/PoE-HarvestVendor/tree/master

Capture2text 菜園OCR軟體

https://sourceforge.net/projects/capture2text/files/Capture2Text/Capture2Text_v4.6.2/

歐付寶連結:

https://payment.opay.tw/Broadcaster/Donate/813F2FDEAB86CCC7CD7F15EAB2815A7B

我的實況連結stream link:

https://www.twitch.tv/freetitude

實況精華連結HighLight:

https://www.twitch.tv/freetitude/videos?filter=highlights&sort=time

我的人物檔案profile:

國際服GGG SERVER→https://www.pathofexile.com/account/view-profile/freetitude/characters

想看POB的話直接在POB的import上面打我的帳號freetitude就好

料理漫畫運用於華語教學之研究

為了解決ocr工具 的問題,作者歸皮爾 這樣論述:

隨著華語作為二語日漸普及,學生在教室外使用各種不同的管道來精進自己的語言發展是很普遍的現象。對多數華語為二語的學習者而言,「漫畫」(comic books) 是眾多易取得資源的管道之一。許多學習者均從「漫畫」中得到似乎無窮無盡的「可理解輸入」(comprehensible input),培養學習者進行傳統文學作品的閱讀及比較的技巧。本論文的研究重點是如何將漫畫融入實際的華語課堂環境。本論文的第一步回顧內容導向教學以及廣泛閱讀教學的相關文獻,並提出在華語課堂環境中使用漫畫協助教學的框架和原則。接著選擇兩部具有共同主題內容 – 料理 – 的漫畫,並進行以下分析:首先,取出漫畫中的文本,以獲取有關

漫畫詞類和難度的數據,並跟不同類型之文本進行比較。其次,嘗試鑑定漫畫中的哪些特徵符合內容和語言的整合學習 (CLIL) 的要求。最後,根據結果編寫教案,並提出相關提示與建議。本論文結果支持前人研究結果,認為:(1) 透過廣泛閱讀教學計劃,漫畫可以順利融入華語課堂環境,達到良好的教學效果。(2) 大量的閱讀是傳統華語教學經常缺乏的一點,漫畫融入教學有助於讓中級學習者對中文閱讀有初步的能力,並能提高閱讀興趣,讓學習者成為自主學習者。

全格局使用PyTorch - 深度學習和圖神經網路 - 基礎篇

為了解決ocr工具 的問題,作者李金洪 這樣論述:

深度學習擅長處理結構規則的多維資料(歐氏空間),但現實生活中,很多不規則的資料如:社群、電子商務、交通領域,多是之間的關聯資料。彼此間以龐大的節點基礎與複雜的互動關係形成了特有的圖結構(或稱拓撲結構資料),這些資料稱為「非歐氏空間資料」,並不適合用深度學習的模型去分析。 圖神經網路(Graph Neural Networks, GNN)是為了處理結構不規則資料而產生的,主要利用圖結構的資料,透過機器學習的方法進行擬合、預測等。 〇 在結構化場景中,GNN 被廣泛應用在社群網站、推薦系統、物理系統、化學分子預測、知識圖譜等領域。 〇 在非結構化領域,GNN 可以用在圖

型和文字等領域。 〇 在其他領域,還有圖生成模型和使用 GNN 來解決組合最佳化問題的場景。 市面上充滿 NN 的書,但卻沒有一本完整說明 GNN,倘若不快點學這個新一代的神經網路,你會用的普通神經網路馬上就會落伍了!非歐氏空間才是最貼近人類生活的世界,而要真正掌握非歐氏空間的問題解決,GNN 是你一定要學的技術,就由本書一步步帶領你完全攻略! 〇 使用 Graph 概念取代傳統的歐氏空間神經元 〇 最好用的 PyTorch + Anaconda + Jupyter 〇 從基礎的 CNN、RNN、GAN 開始上手神經網路 〇 了解基礎的啟動函數、損失函數、L1/

L2、交叉熵、Softmax 等概念 〇 NLP 使用神經網路處理 + 多頭注意力機制 〇 Few-shot/Zero-shot 的神經網路設計 〇 空間域的使用,使用 DGL、Networkx 〇 利用 GNN 進行論文分類 本書特色 ~GNN 最強入門參考書~ ● 以初學者角度從零開始講解,消除讀者學習過程跳躍感 ● 理論和程式結合,便於讀者學以致用 ● 知識系統,逐層遞進 ● 內容貼近技術趨勢 ● 圖文結合,化繁為簡 ● 在基礎原理之上,注重通用規律

Very High Precision Optical Character Recognition For Clean-Fixed-Sized True Type Characters

為了解決ocr工具 的問題,作者簡嘉慶 這樣論述:

光學文字辨識(OCR)已經是個發展多年的技術,但是現今卻還沒有一個辨識率百分之百的工具。這個問題是因為辨識影像的來源有很多種不同的狀況,例如文字影像的品質、各式各樣的文章排版、不同的語言、千變萬化的字體、大大小小的文字。只要有其中一項變動,就會對辨識率有極大的影響。本研究是要應用在本實驗室之 Korat 自動化回歸測試系統上,辨識影像的來源是由 Korat 擷取待測系統的螢幕。因為辨識的影像來源是從螢幕截圖,所以影像會是端正、乾淨且無雜訊。基於這個特性,本研究不需要面對一般 OCR 工具會遇到的情況,如影像歪斜和雜訊干擾的問題。但是會面臨到辨視率需要100%的需求,所以即使在市面上有諸多的

OCR 工具的辨識率都有 88%-95%左右,但仍然無法符合實際應用在 Korat 的系統上的要求。本研究使用樣板比對的方法結合動態規劃的演算法,在所有可能的辨識組合中,比較剩餘的像素總和,以剩餘最小的組合視為最佳解,藉此辨識率 100%。

想知道ocr工具更多一定要看下面主題

ocr工具的網路口碑排行榜

-

#1.如何透過4 個簡單的步驟,在PDF 中使用OCR 軟體 - Adobe

探索Adobe Acrobat 中的OCR 軟體功能,了解將PDF 轉換為可編輯的文字有多簡單。 ... 使用OCR 輕鬆編輯掃描的PDF 文件 ... 按一下右窗格中的「編輯PDF」工具。 於 www.adobe.com -

#2.使用Google AI 導入OCR

Google Cloud 採用業界一流的AI 技術來支援OCR。這項工具不只是要辨識傳統文字,還能夠解讀、整理及充實資料,最終產生符合企業需求的深入分析資料。 於 cloud.google.com -

#3.在线ocr工具 - 稀土掘金

在线OCR 工具是指可以在网络上使用的OCR(Optical Character Recognition,光学字符识别)软件。使用这种工具,你可以将扫描的文档或者数码照片中的文字转化为可编辑的 ... 於 juejin.cn -

#4.光學字元辨識(OCR)科技的過去與未來

這就是OCR和ICR等掃描科技發揮作用的時候。您可以使用OCR工具掃描打印的文件並數碼化所有文字。 OCR的科技已經廣泛使用,您可能已經很熟悉,它 ... 於 www.crownrms.com -

#5.OCR识别常见的八大开源工具 - 51CTO

OCR 技术作为一项重要的人工智能技术,已经得到了广泛的应用,并且将会越来越重要。通过使用开源的OCR框架和工具,开发者可以更灵活地构建高质量的OCR ... 於 www.51cto.com -

#6.誠華OCR - 圖片轉文字- 免費在線OCR

選擇文件 · 選擇您的文檔語言 · 選擇輸出格式 · 開始轉換. 於 zhtw.109876543210.com -

#7.OCR識別有這6款工具就夠! - LightPDF

OCR 識別的用處實在是太多!究竟哪個工具真的準確率高還免費呢?!本文搜集了6款實用OCR文字提取工具:LightPDF、Onenote、Free Online OCR…… 於 lightpdf.com -

#8.OCR 轉換器- 免費在線提取掃描文本 - Xodo

OCR 工具 用於識別和提取PDF 文檔和掃描圖像中的文本。我們的PDF OCR 轉換器是一個免費的解決方案,適用於希望從文件中獲取額外文本的用戶。 於 xodo.com -

#9.ocr工具 - 天达云

云虚拟主机支持ASP / PHP5.2-8.2 / ASP.NET 1.1-4.8 送MYSQL和MSSQL两个数据库,全面完美兼容各种主流程序。高IO性能NVME SSD硬盘存储,附送CDN网站加速,高带宽,8大 ... 於 www.tdyun.com -

#10.PearOCR 超方便的OCR 圖片轉文字工具 - 哇哇3C日誌

PearOCR 是一款免費線上工具,操作非常簡單,你只要將OCR 文字圖片上傳或拖曳到網站中,網站就會自動將圖片中的中英文內容轉換為純文字,或導出PDF 檔傳給朋友也可以,此外 ... 於 ez3c.tw -

#11.什麼是OCR? – 光學字元辨識 - Amazon AWS

文字處理軟體無法以處理文字文件的相同方式,來處理影像中的文字。運用OCR 技術,可將文字影像轉換為其他業務軟體可分析的文字資料,進而解決此問題。然後,您可以使用該 ... 於 aws.amazon.com -

#12.超強免費PDF 轉檔、OCR 文字辨識工具「LightPDF」 - 硬是要學

想要把PDF 轉為Microsoft office 文件或者把office 文件轉為PDF 嗎?推薦你使用LightPDF這個免費的線上服務,超過20 種功能包括DPF 轉檔、OCR 光學字 ... 於 www.soft4fun.net -

#13.OCR 識別PDF 中的文本在線免費 - DeftPDF

要使計算機將其內容識別為字符,您需要使用OCR 工具將其轉換為機器可讀文件。 1.上傳您的文件. 您可以放心 ... 於 deftpdf.com -

#14.Top 50件ocr翻譯- 2023年5月更新- Taobao - 淘寶

圖片轉文字識別軟體PDF掃瞄轉換器OCR文字提取翻譯工具準確率高. 7人說“好好用”. ¥. 2.99. 已售50+件. 收藏. 100+評價. 天若OCR圖片文字識別翻譯軟體無限制離線本地 ... 於 world.taobao.com -

#15.Ocr 軟件的價格推薦- 2023年5月| 比價比個夠BigGo

「ocr 軟件」哪裡買、現貨推薦與歷史價格一站比價,最低價格都在BigGo! ... PDF-XChange Editor PDF文件編輯工具軟體win 正版軟件序號Editor-Plus OCR文字. 於 biggo.com.tw -

#16.2023 有推薦的OCR 工具軟體嗎?EasyScreenOCR 支援中文 ...

EasyScreenOCR 2.6.0 實用的OCR 圖片文字辨識工具,支援中文字的辨識,回想起學生時代要撰寫論文,很多PDF 文獻可以參考,不過只能逐字跟著打, ... 於 blog.easylife.tw -

#17.20个最好的免费和付费的OCR(光学字符识别)软件

了解所有关于20种最好的免费和付费OCR工具的信息,包括主要功能、价格以及更多。 於 marketsplash.com -

#18.如何利用OCR工具擷取圖檔內的文字資訊?|Kdan PDF Reader

了解如何使用OCR 轉檔工具從掃描的PDF文件和圖像中辨識和提取文字,並將檔案轉換為可搜索內文且可編輯的PDF文件。 於 www.kdanmobile.com -

#19.完全免费,不用联网,这套OCR工具比微信的还好用!

除了功能实用,另一方面,微信早已成了电脑上必装软件,微信截图也是很多人默认截图工具。 所以微信OCR 就好比系统功能一样,无需任何安装成本,以后遇到 ... 於 redian.news -

#20.【心得】OCR中文翻譯工具第二彈!MORT,專門給玩家的遊戲 ...

大家安! 不知道大家還記得之前這篇嗎? 【心得】沒中文看不懂劇情對話?試著用OCR工具Capture2Text翻譯成中文吧! 在那之後我又陸陸續續找了很多OCR ... 於 forum.gamer.com.tw -

#21.將PDF 和相片檔案轉換為文字- 電腦- Google 雲端硬碟說明

在檔案上按一下滑鼠右鍵。 依序按一下「選擇開啟工具」 下一步 「Google 文件」。 系統會轉換圖片檔,但格式可能無法轉移 ... 於 support.google.com -

#22.用Python 寫了一個圖像文字識別OCR 工具- 閱坊

在之前的文章裏,我們多次嘗試用Python 實現文本OCR 識別! ... 不過今天我們要搞一個升級版:直接寫一個圖像文字識別OCR 工具! 於 www.readfog.com -

#23.OCR文字识别软件哪个好?这三个OCR工具带给你惊喜!风云软件

这三个OCR工具带给你惊喜!风云软件. 发布时间:2021-09-02 18:07:30. 在我们日常工作和日常学习中,有时候我们需要将图片、PDF 或者书籍的文字转换成可以编辑的文字, ... 於 www.fengyunpdf.com -

#24.使用深度學習OCR 讀取複雜條碼- 部落格 - Cognex

使用深度學習OCR 在任何條件下讀取複雜與難讀的條碼. Deep learning ocr tool. 試想預先訓練的光學字元辨識(OCR) 與字元識別(OCV) 工具所能節省的時間。這項工具不需要 ... 於 www.cognex.com -

#25.必用的財報整理工具-FineReader OCR Pro

我所設定的重點是: 能將PDF裡的圖檔,辨識出文字,以便能快速尋找到關鍵資訊。 這部分就要透過OCR(光學字元辨識)工具來處理轉檔,像Adobe的Adobe acrobat ... 於 duncanteng.me -

#26.OCR工具集下载v1.0免费版

OCR工具 集,OCR工具集是一款功能强大出色的OCR识别软件,有丰富的软件功能,通过该软件用户可以随时进行OCR的识别,支持多种识别功能,帮助大家可以轻松的提取图片中的 ... 於 www.pc6.com -

#27.在线OCR图片文字识别工具

在线OCR图片文字识别工具,可以一键识别图片中的文本信息,快速将图片转成文字,支持截图后粘贴识别,操作更加高效快捷。 於 uutool.cn -

#28.OCR文字识别工具-图片识别成文字的工具 - 蛙蛙工具

OCR 文字识别工具方便的把图片中的文字识别出文本来,辨识率非常高,欢迎使用。 於 www.iamwawa.cn -

#29.OCR (光学字符识别)。在线自由 - Convertio

OCR (光学字符识别)。在线自由. 简单的工具来扫描文档转换为可编辑的Word、PDF、Excel和Txt(文本)输出格式。 可用页: 10 (您已经使用了0 页). 於 convertio.co -

#30.線上OCR:圖片轉文字轉換器 - Dropbox.com

Dropbox 的光學文字辨識(OCR) 工具可讓您搜尋並複製紙本掃描文件的文字。了解更多。 於 www.dropbox.com -

#31.微軟PowerToys即將新增OCR工具,可複製圖像中的文字

開發者Joseph Finney替微軟的公用程式PowerToys增添光學字元辨識(OCR)功能,預計幾個月後正式納入PowerToys. 於 www.ithome.com.tw -

#32.OCR 光學文字識別工具Readiris ProV12 繁體中文 ... - XYZ教育王

Readiris Pro是處理文字識別的OCR工具軟體,其強大的識別能力和豐富的字形檔可使識別率達到98%以上。具有多稿處理功能,將多篇檔掃描後一併識別,存儲 ... 於 xyz88.com -

#33.白描- OCR文字識別與文件掃描4+ - App Store

閱讀評論、比較客戶評分、查看截圖,並進一步瞭解「白描- OCR文字識別與文件掃描」。下載「白描- OCR文字識別與文件掃描」並在iPhone、iPad、iPod touch 或是Mac OS X ... 於 apps.apple.com -

#34.PDF 轉文字–免費線上OCR轉換工具

免費PDF OCR服務. 享用完全免費的OCR工具,無需註冊。沒有彈窗和廣告。 精准OCR. 即使PDF是掃描 ... 於 pdfcandy.com -

#35.好用:OCR 圖片文字識別工具,免安裝綠色版僅2MB - 每日頭條

今天介紹一款非常輕小的OCR,綠色免安裝的小工具僅2M,集成了各大網站的ORC識別接口,集合百度、騰訊、有道、搜狗,識別速度非常快與準確的;. 於 kknews.cc -

#36.好用雲端工具- 線上OCR圖形字元辨識 - 正興國小

「Free Online OCR」是一款免費的線上光學字元辨識服務,如果你要把掃描的PDF 文件或圖片(JPG、PNG、BMP、TIFF 或GIF)內文字輸出成Word、Excel 或可編輯的純文字格式 ... 於 www.jsps.kh.edu.tw -

#37.如何將圖片轉換成文字?這幾款OCR文字辨識軟體不要錯過

天若OCR就是一款Windows平臺上的圖片文字辨識工具,支援jpg,jpeg,png,bmp以及pdf幾種格式,辨識文字之後自動轉換成word檔,它支援豎版辨識,公式 ... 於 www.apowersoft.tw -

#38.中研院-數位人文學研究室- 緊急需要OCR工具時 - Facebook

緊急需要OCR工具時,Google翻譯APP是很方便的選擇,而且免費。 於 zh-tw.facebook.com -

#39.【2023】5款Win10 OCR 實用小工具,批量識別加翻譯 - PDNob

Win10 OCR內建工具 · PDNob 圖片轉文字翻譯器 · OneNote · Google Docs · Acrobat Adobe ... 於 www.pdnob.com -

#40.EasyScreenOCR: 將圖片轉換為文本的免費在線工具

簡單易用的圖片文字識別工具. ocr image online with privacy protected. 100% 免費與安全. 我們提供了100%免費的OCR文字 ... 於 online.easyscreenocr.com -

#41.UPDF:一款真正懂你的OCR工具- 简书

使用OCR功能之后, 不仅转换文档质量高,转换后的PDF 文档的体积会比原始文档小得多。 不同于市面上质量参差不齐的OCR工具,UPDF 考虑到用户真实的需求, ... 於 www.jianshu.com -

#42.产品文字辨识软件开发工具包(OCR SDK ) - NewSoft

光学字符识别软件开发工具包( Optical Character Recognition Software Development Kit, OCR SDK),提供开发者及设备制造商,整合OCR SDK并应用于软件流程或嵌入于硬设备 ... 於 cn.newsoft.com.tw -

#43.五款免費中文OCR 文字辨識軟體下載,建立強大無紙化辦公室

這個工具也是適合「行動中文字辨識」,打開Office Lens ,對紙張拍照,就能將紙張內的文字轉成Word 等Office 文件,同步到OneDrive 。 5. 用Copyfish OCR ... 於 www.playpcesor.com -

#44.字符图片OCR工具 - YXZ's Blog

字符图片OCR工具. 发表于:2021-04-24. 前言. 由于自己的某些学习需求,不想一直联网 ... 於 yaoxuanzhi.github.io -

#45.白描网页版: 图片转文字在线- 图片文字提取- 网页OCR文字识别

免费在线图片文字识别,支持简体、繁体、英文、韩语、日语、俄语等多国语言的准确识别,识别结果可复制或下载txt或word,点击按钮选择图片、将图片拖入此虚线框、从剪 ... 於 web.baimiaoapp.com -

#46.推荐一款强大的OCR工具原创 - CSDN博客

Umi-OCR 是一款非常优秀的OCR 工具,它的准确度高、速度快、支持多种语言识别,可以满足用户的各种需求。无论是需要处理大量文档的企业,还是需要将纸 ... 於 blog.csdn.net -

#47.微软PowerToys将新增OCR工具,可复制图像中的文字 - 电玩巴士

Windows开发者Joseph Finney在今年7月开启一个拉取请求(Pull Request),替微软的PowerToys添加光学字符识别(OCR)功能,可用来识别和复制图片中的 ... 於 m.tgbus.com -

#48.PearOCR 線上OCR 辨識免費工具(圖片轉文字),支援多國語言

隨著科技進步,現在要將圖片轉文字,直接透過線上工具就能實現,像這篇要介紹的PearOCR 就是,完全免費,且支援辨識多國語言,從繁體中文、簡體中文、 ... 於 www.kocpc.com.tw -

#49.6 个优秀的开源OCR 光学字符识别工具 - 阿里云开发者社区

选择正确的OCR工具要基于特定需求而定,例如在线OCR服务对某些人有用,但可能存在隐私问题和文件大小限制。 OCR软件非大众产品,因此开源替代相对于商业级重量级产品相对较 ... 於 developer.aliyun.com -

#50.電腦軟體:::行政管理軟體工具:::SPEEDEYE 公文OCR辨識軟體

全新SPEEDEYE公文OCR辨識軟體,獨創Web-based開發掃描平台,紙本收文辨識的最佳選擇,採用智能辨識校正技術,提升辨識率,支援TWAIN國際標準介面的掃描器或事務機整批 ... 於 www.cloudmarketplace.org.tw -

#51.OCR Converter 文字辨識- Apps發行說明 - QNAP

首頁 > Apps發行說明 > 工具 > OCR Converter 文字辨識 ... OCR Converter 1.2.4 ... Users can access OCR Converter functions with AD and LDAP account. 於 www.qnap.com -

#52.單擊閱讀圖像OCR 擴充功能,選取範圍就能把圖片轉成文字 ...

現在網路上有很多OCR 免費工具,不過都需要手動上傳圖片,操作上多少有些麻煩,而這篇就要推薦一個非常方便的「單擊閱讀圖像」擴充功能,只需要... 於 today.line.me -

#53.OCR工具-哔哩哔哩_Bilibili

Umi-OCR文字识别工具,免费方便离线高效精准,OCR图片转文字识别软件,完全离线。截屏/批量导入图片,支持多国语言、合并段落、竖排文字。可排除水印区域,提取. 於 search.bilibili.com -

#54.【2022】免費6 款最好用OCR 文字辨識軟體將圖片轉文字

1. PDNob 圖片轉文字 – 最佳OCR 軟體 · 2. PDNob PDF Online -免費線上OCR 軟體 · 3. Google 文件 · 4. Google 翻譯OCR · 5. Microsoft OneNote OCR · 6. Adobe. 於 www.tech-girlz.com -

#55.Umi-OCR 文字辨識工具

Potato Media 以電玩、動漫、3C、運動、汽機車、美食、理財等內容為主題,除了站內有諸多優秀內容創作者經營個人社群,更讓創作者及所有讀者透過產生 ... 於 www.potatomedia.co -

#56.免费在线PDF OCR 工具:快速、准确 - AvePDF

OCR 是一种多功能工具. OCR代表“光学字符识别”。 OCR引擎实质上是尝试将图像转换为文本。借助OCR,我们可以从扫描的文档中提取,复制,粘贴甚至朗读(由于使用了Text To ... 於 avepdf.com -

#57.Gocator® 3D智能传感器最新支持光学字符识别(OCR)及 ...

LMI Technologies公司发布的Gocator® 新工具支持读取和验证印刷、浮雕的2D和3D条码、标签或字母数字字符。 2019年11月14日/不列颠哥伦比亚省温哥华市– 作为全球领先 ... 於 lmi3d.com -

#58.免费的OCR识别工具就是香! - 腾讯云

下面分享一款电脑端的OCR 文字识别软件——「PaddleOCR」,可以帮助我们解决这一问题。 PaddleOCR旨在打造一套丰富、领先、且实用的OCR工具库,助力使用 ... 於 cloud.tencent.com -

#59.Ai圖片轉文字|完全免費的強大集成工具 - YouTube

影片章節0:00 影片前言0:59 ShareX介紹1:43 前置設定4:10 實際使用6:58 OCR 文字辨識9:13 結語 文字辨識集成 工具 ShareX ... 於 www.youtube.com -

#60.hiroi-sora/Umi-OCR: OCR图片转文字识别软件,完全 ... - GitHub

忽略区域 如何排除截图水印处的文字? 多国语言 添加更多PP-OCR支持的语言模型库! 命令行调用 用命令行或第三方工具来调用Umi- ... 於 github.com -

#61.OCR工具见多了,但今天这个效果真的惊艳! - 什么值得买

掐指一算,感觉自己好久没写过OCR 识别工具了。当然,没写是有原因的,去年7 月份的时侯向大家安利了能调用N 个大厂接口,一步到位的Panda. 於 post.smzdm.com -

#62.UPDF:一款真正懂你的OCR工具_识别_文档_文件 - 搜狐

UPDF:一款真正懂你的OCR工具 ... 近几年,OCR(Optical Character Recognition,光学字符识别) 开始为大众所熟知,越来越多的人开始使用OCR 来解决扫描版 ... 於 www.sohu.com -

#63.OCR工具集(OCR识别软件) V1.0 绿色免费版 - 脚本之

OCR工具 集(OCR识别软件) V1.0 绿色免费版,OCR工具集是一款非常简单好用的OCR识别软件,该软件的功能非常的丰富,通过该软件用户可以随时进行OCR的识别 ... 於 m.jb51.net -

#64.超實用筆記工具!Text Grab把影片、圖片內容轉換成文字

現在有很多OCR的工具,幫助我們把圖片中的文字快速辨識、擷取出來,整理成屬於自己資料。今天要介紹一款Windows上的開源免費軟體:Text Grab|Meet ... 於 meet.bnext.com.tw -

#65.2022 年15 種最佳OCR 軟體(免費和付費工具)

第2 部分: 6 種適用於桌上型電腦的最佳OCR 軟體 · 第1 種:Wondershare PDFelement · 第2 種:ABBYY FineReader PDF 15 · 第3 種:Nanonets · 第4 種:Adobe Acrobat Pro DC ... 於 pdf.wondershare.tw -

#66.圖片轉文字- 將掃描的PDF轉檔為Word - 線上OCR - HiPDF

通過OCR可將圖片或掃描的PDF文件轉檔為可編輯的文檔(Word,PPT,Excel,TXT),識別精准,操作簡單,無需付費,無需安裝軟體。 ... 線上和桌面OCR工具之間的區別 ... 於 www.hipdf.com -

#67.多功能OCR 高架掃描器 - IPEVO 愛比科技

多功能OCR 高架掃描器 · 商品排序 · 上架時間: 由新到舊 · 上架時間: 由舊到新 · 價格: 由高至低 · 價格: 由低至高 · 銷量: 由高至低. 於 www.ipevo.com.tw -

#68.NewOCR 免費線上OCR 工具,辨識圖片文字轉為可編輯格式

其實只要透過OCR(光學字元識別)技術就能利用機器辨識圖片中的內文,再將內容轉為純文字格式輸出,而這類軟體或工具也很多,例如Google Keep 內建OCR 文字辨識功能可 ... 於 free.com.tw -

#69.免費好用的OCR文字辨識軟體推薦 - 銳力電子實驗室

除此之外,它還提供了多種工具,比如拼寫檢查器等,方便您在後期對文本進行細緻的檢查。 支援的作業系統:Linux、Windows。 OCR文字辨識. 於 www.reneelab.net -

#70.「ocr工具」相关问答|文档|产品 - 七牛云

本页面为您提供与ocr工具相关的问答、文档、产品、活动等内容。除ocr工具以外,我们还找到了您可能感兴趣的ocr识别失败、ocr识别哪个好用、ocr车牌识别、ocr安卓破解 ... 於 www.qiniu.com -

#71.在线文字识别转换- 免费图片转文字工具OCR - 在线工具系列

免费的文字在线识别工具- 通过图片识别文字,可保留原始格式,提供图像文字识别,提取图片文字,pdf文字识别,扫描文件识别服务、pdf转Word文档服务等。我们的Ocr服务 ... 於 ocr.wdku.net -

#72.單擊閱讀圖像(OCR)

實用工具. 40,000+ 位使用者. 總覽. OCR文本識別,圖片文本識別,Web屏幕截圖文本識別。 從任何圖像,視頻或PDF複製和粘貼文本。 於 chrome.google.com -

#73.如何開啟OCR? - 工具城市

我如何在PDF中啟用OCR? 在Acrobat for Mac或PC中打開一個包含掃描圖像的PDF文件。點擊右窗格中的"編輯PDF "工具 ... 於 tools.city -

#74.[工具] 強大的ocr辨識和翻譯軟體落寞ocr - 教學區 | NVDA 台灣

[工具] 強大的ocr辨識和翻譯軟體落寞ocr - 教學區 ... 不同於普通的ocr辨識,他可以被用來辨識我們完全無法操作的軟體,透過一個列表將辨識出的文字 ... 於 www.nvda.org.tw -

#75.新一代OCR 文字辨識及擷取方案 - Datax

Datax OCR 專門為企業提供高準確度、可客製化的完整OCR 方案。 ... 設計、軟件工程師團隊,可按需求客製最適合的OCR 工具或完整方案 提供全面售後維護服務 ... 於 datax.io -

#76.OCR工具- tesseract - 努力的孔子- 博客园

OCR工具 - tesseract. 操作不复杂,自己看参考资料吧;. 可用命令行,也可用代码. 复制代码. from pytesseract import pytesseract from PIL import ... 於 www.cnblogs.com -

#77.生產力軟體推薦— TextSniper,實用Mac OCR 軟體 - Medium

這篇文章介紹TextSniper 桌機OCR 軟體,能夠用截圖的方式辨識文字。 ... 是朱騏,一個組織能力超強的軟體產品經理,喜歡研究各種生產力工具、時間管理 ... 於 medium.com -

#78.OCR - 小众软件

Umi-OCR 是一款适用于Win10 x64 平台的免费、离线OCR 文字识别工具,基于PaddleOCR,支持批量导入、读取剪贴板,可排除图片中水印区域,提取干净的文本。@Appinn 感谢 … 於 www.appinn.com -

#79.2023年10款好用的OCR文字识别软件推荐 - v1tx

利用OCR软件将文档或图片识别成文字,不仅让我们的录入工作更加简单,而且更便于存储和检索,非常建议使用这些OCR工具,不管简单的QQ截图还是专业 ... 於 www.v1tx.com -

#80.2023 推薦4款【圖片轉文字】工具!Google、LINE、線上OCR ...

免安裝,電腦(Windows、Mac)和手機(Android、iOS)都可以用~直接用Google雲端硬碟、LINE照片轉文字,或是網頁版的線上的OCR辨識文字工具,都能將圖片中的英文、繁體 ... 於 www.pkstep.com -

#81.OcrPHP PHP的OCR工具包-电子发烧友网

OcrPHP PHP的OCR工具包 ... 所属分类 程序开发、 OCR开发包 ... OcrPHP 是一个一个简洁优雅的图像识别转换文字的php类库, 须安装 tesseract-ocr ... 於 m.elecfans.com -

#82.天若OCR 文字识别工具- 快速一键截图识别屏幕文字的开源电脑 ...

尽管专业的OCR 文字识别软件、手机APP 很多,但如果想快速复制电脑屏幕上任意地方的文字的话,大多这类工具都不够便捷。如能像QQ 截图那么方便,用鼠标拉 ... 於 www.iplaysoft.com -

#83.《白描》推出Windows 版,朝「最佳中文OCR 识别工具」更 ...

白描是一款简单好用的OCR 文字识别与扫描工具,主要功能有提取图片中的文字、图片表格转Excel、公式识别、文件扫描、身份证扫描、合成PDF 等。 於 sspai.com -

#84.通过OCR识别文本- 简便,在线,免费- PDF24 Tools

通过OCR识别文档中文本的免费在线工具。建立可搜索的PDF文件。 很多选择。没有安装。没有注册。 於 tools.pdf24.org -

#85.PowerToys 适用于Windows 的Text Extractor 实用工具

Text Extractor 只能识别已安装OCR 语言包的语言。 可以通过运行以下命令通过PowerShell 获取列表:. PowerShell 复制. 於 learn.microsoft.com -

#86.Google 雲端硬碟圖片文字辨識OCR 使用教學,處理直書與橫書 ...

市面上的圖片文字辨識(OCR)軟體其實不少,以往最有名的應該就是丹青文件辨識系統,而後來也出現很多免費的軟體,我在網路上研究了一陣子, ... 於 blog.gtwang.org -

#87.实用工具| 6款免费OCR神器,总有一款适合你! - 知乎专栏

本期内容 · 福昕PDF编辑器 · 1/网页端OCR · ocr.space · 极客OCR · 2/PC端 · ShareX · 树洞OCR. 於 zhuanlan.zhihu.com -

#88.功能實用的OCR文字識別工具-EasyScreenOCR 2.6.0 中文免安裝

Easy Screen OCR是一款功能實用的OCR文字識別工具,該工具可以幫助用戶輕鬆便捷的進行OCR識別操作,它支持中文識別,用戶可以將圖像上的文字儲存並 ... 於 softblog.tw -

#89.Windows/iOS/Android 上的最佳在線OCR 軟件

此外,它還可以幫助用戶從圖像文件中提取Excel 表格。因此,我們可以在下面的文本掃描儀中詳細了解OCR 工具! Best Online OCR Software. 尋找更多其他OCR ... 於 www.bitwarsoft.com -

#90.OCR工具集,超级好用的免费OCR识别工具 - 乐软博客

OCR 识别工具多如牛毛,各种免费开源的工具比比皆是,和上面的语音转换一样,国内的大厂也基本都提供相关的付费服务,例如阿里、搜狗等,其识别的准确 ... 於 www.isharepc.com -

#91.具有OCR精确度的详尽OCR工具包。ABBYY技术

OCR 技术可用于200多种语言,包括欧洲和非欧洲语言(CJK,阿拉伯语等)。 Features 189 44X44. 功能强大的PDF处理工具. 该SDK提供文件转换为可搜索的 ... 於 www.abbyy.cn -

#92.image to text | OCR multiple S - Google Play 應用程式

轉錄筆記,書籍甚至圖片,並將它們轉換為計算機上的文本。 使用我們的光學字符識別(OCR)工具從書籍,文檔,筆記中捕獲文本並將其數字化 於 play.google.com -

#93.使PDF成為可搜索內容的文檔。線上OCR工具。 - iLovePDF

對你的PDF進行OCR識別,即可從掃描的文檔中獲取文本。只需上傳PDF文檔,然後自動識別文本。免費讓您的PDF成為可搜索內容、可選擇內容的文檔。 於 www.ilovepdf.com -

#94.图像OCR 转换器

图像OCR 转换器. 将您的图像转换为可编辑的文本。 OCR2Edit. 图像OCR 转换器. 对文件在线使用高级文本识别。 请选择以下ocr工具之一: ... 於 www.ocr2edit.com -

#95.PearOCR 完全免費的「在線OCR 文字識別」工具, 輕鬆轉換 ...

使用免費的「在線OCR 文字識別」工具, 輕鬆轉換圖片上的文字. ... OCR稱為「光學字元識別」(英文全名是Optical Character Recognition ),主要功能 ... 於 itorz324.blogspot.com -

#96.完全免费不用联网这套OCR工具比微信的还好用!-快科技

除了功能实用,另一方面,微信早已成了电脑上必装软件,微信截图也是很多人默认截图工具。 所以微信OCR 就好比系统功能一样,无需任何安装成本,以后遇到 ... 於 news.mydrivers.com -

#97.ocr工具_抖抖音

您在查找ocr工具吗?我们提供全网最全的内容介绍,每天实时更新,最新最全的资讯一网打尽。 於 page.iesdouyin.com